구글의 텐서처리장치(TPU)가 엔비디아 그래픽처리장치(GPU)의 대항마로 부상하고 있습니다. TPU는 원래 구글 내부에서만 사용하던 인공지능(AI) 훈련·추론용 칩으로, 과거의 GPU 보완재 이미지를 벗고 당당히 GPU의 경쟁 상대가 됐습니다. TPU의 가치가 집중 조명을 받은 건 최근 일이지만, 구글이 AI용 컴퓨터 칩 시장에 모습을 드러낸 건 10년 전으로 거슬러 올라갑니다.

엔비디아 GPU 대항마로 부상한 구글 TPU

AI 챗봇 '클로드'로 유명한 미국 스타트업 앤스로픽은 지난달 23일(현지시간) 구글과 컴퓨터 인프라 계약을 체결했습니다. 내년까지 1기가와트(GW) 규모의 TPU 데이터센터를 임대하기로 했지요. 뒤이어 메타도 구글과의 TPU 구매 계약을 논의 중이라는 보도가 나왔습니다. 미 IT 매체 '디 인포메이션'에 따르면, 현재 구글은 AI 가속기 시장 점유율 10%대를 목표로 합니다. 그동안 AI 가속기 시장은 엔비디아 GPU가 90%를 장악했는데, 처음으로 의미 있는 경쟁자가 나온 셈입니다.

구글은 AI 산업의 선구자격 기업이지만, 사업 영역은 서비스와 소프트웨어로 제한됐습니다. 그런 구글이 AI 하드웨어에서 AMD 등 쟁쟁한 기업들을 제칠 수 있었던 비결은 TPU에 있습니다. TPU는 올해 초 7세대까지 공개된 구글의 자체 개발 AI 가속기로, 구글은 TPU 덕분에 엔비디아 의존도를 줄이고 AI 데이터센터 인프라를 수월하게 확장할 수 있었습니다.

AI 반도체 선도 기업 구글, 10여년 투자 결실

사실 구글은 AI 하드웨어 분야에서도 선도적인 기업이었습니다. 엔비디아가 AI용 GPU의 초석을 닦은 '다용도 GPU(GPGPU)' 개발을 추진한 해가 2006년인데, 구글 또한 같은 해 기계 학습용 반도체 팀을 꾸린 것으로 알려졌습니다. 이 반도체 팀은 2015년 연구의 결과로 TPUv1을 내놨습니다. 구글이 신경망 AI 스타트업 '딥마인드'를 인수한지 1년째 되는 해였지요.

딥마인드가 바둑 두는 AI '알파고'를 개발해 이세돌 9단과 대결을 펼친 2016년 당시 구글은 엔비디아 GPU와 TPU를 혼용했지만, 이후에는 TPU 비중을 늘리기 시작합니다. TPUv1은 흔히 '레거시 반도체'라 불리는 28나노미터(nm) 공정으로 개발됐으며 성능도 GPU를 대체하기보다는 보완하는 수준에 그쳤으나, 구글은 자체 반도체에 대한 투자를 멈추지 않았습니다. 덕분에 TPU는 올해 초까지 7번의 설계 개량을 거쳐 GPU 못지않은 최첨단 반도체로 거듭났고, 이제는 ARM 기반 중앙처리장치(CPU) '액시옴'과 함께 구글의 실리콘 생태계를 완성합니다.

AI 연산에 특화된 시스톨릭 구조 반도체TPU는 오직 딥러닝 가속을 위해 설계된 '맞춤형(ASIC)' 반도체입니다. CPU는 컴퓨터 업무의 대부분을 처리하고, GPU는 그래픽 처리를 비롯한 여러 고급 기능을 가속한다면, ASIC는 오직 특정 업무에만 특화된 칩입니다. TPU의 경우 AI용 행렬 곱셈 연산에 최적화된 '누산기'라는 장치를 수천개 탑재했지요. 구글은 해당 설계를 '시스톨릭 구조 아키텍처'라고 칭합니다.

그 결과 TPU는 CPU·GPU 같은 범용성은 부족하지만, AI 처리 작업만큼은 타의 추종을 불허합니다. 실제로 TPU는 과거 AI 가속기 전용 벤치마크 테스트인 'ML 커먼스(Commons)'에서도 순수 성능, 전력 대비 성능 비율 측면에서 엔비디아 GPU와 막상막하의 성적을 기록한 유일한 칩이었습니다.

TPU의 또 다른 무기는 '알파칩'이라는 AI입니다. 딥마인드가 지난해 9월 공개한 반도체 설계 AI로, 컴퓨터 칩 기판 기초 설계 작업을 맡고 있지요. AI를 칩 설계 작업에 적극적으로 활용함으로써, 구글은 신규 반도체 개발에 드는 비용과 시간 모두 절감할 수 있습니다.

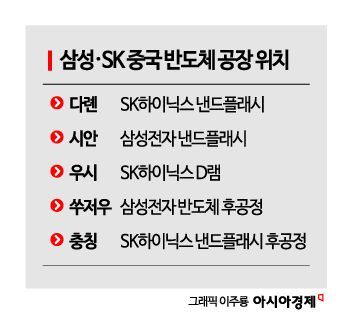

GPU처럼 TPU도 韓 HBM 의존도 커져TPU의 부상은 삼성전자, SK하이닉스 등 국내 반도체 기업들에는 또 다른 기회가 될 가능성이 높습니다. GPU와 마찬가지로 TPU도 성능을 개량하면서 고대역폭메모리(HBM) 의존도를 높이고 있기 때문입니다.

현재 7세대 TPU '아이언우드'는 192기가바이트(GB)의 HBM 저장 용량을 보유합니다. 칩 한 개에 하이닉스의 5세대 HBM인 'HBM 3E 8단(24GB)'이 8개나 쓰이는 셈입니다. 전 세대 제품인 6세대 TPU 대비 HBM 용량을 6배 확대했습니다.

투자은행 뱅크오브아메리카(BofA)의 메릴린치 글로벌 리서치에 따르면, 하이닉스는 이미 구글에 HBM 3E를 독점 납품하고 있으며, 내년 공개되는 8세대 TPU에는 차세대 HBM인 HBM 4도 공급할 전망입니다.

임주형 기자 skepped@asiae.co.kr

▶ 2026년 사주·운세·토정비결·궁합 확인!

▶ 돈 관리 성향, 테스트로 진단해 보기! ▶ 하루 3분, 퀴즈 풀고 시사 만렙 달성하기!

![[포토] 폭설에 밤 늦게까지 도로 마비](https://image.ajunews.com/content/image/2025/12/05/20251205000920610800.jpg)

![[포토] 예지원, 전통과 현대가 공존한 화보 공개](https://image.ajunews.com/content/image/2025/10/09/20251009182431778689.jpg)

![블랙핑크 제니, 매력이 넘쳐! [포토]](https://file.sportsseoul.com/news/cms/2025/09/05/news-p.v1.20250905.c5a971a36b494f9fb24aea8cccf6816f_P1.jpg)

![[포토]두산 안재석, 관중석 들썩이게 한 끝내기 2루타](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.1a1c4d0be7434f6b80434dced03368c0_P1.jpg)

![[작아진 호랑이③] 9위 추락 시 KBO 최초…승리의 여신 떠난 자리, KIA를 덮친 '우승 징크스'](http://www.sportsworldi.com/content/image/2025/09/04/20250904518238.jpg)

![블랙핑크 제니, 최강매력! [포토]](https://file.sportsseoul.com/news/cms/2025/09/05/news-p.v1.20250905.ed1b2684d2d64e359332640e38dac841_P1.jpg)

![[포토] 키스오브라이프 하늘 '완벽한 미모'](http://www.segye.com/content/image/2025/09/05/20250905504457.jpg)

![[포토] 국회 예결위 참석하는 김민석 총리](https://cphoto.asiae.co.kr/listimg_link.php?idx=2&no=2025110710410898931_1762479667.jpg)

![[포토]첫 타석부터 안타 치는 LG 문성주](https://file.sportsseoul.com/news/cms/2025/09/02/news-p.v1.20250902.8962276ed11c468c90062ee85072fa38_P1.jpg)

![[포토] 박지현 '아름다운 미모'](http://www.segye.com/content/image/2025/11/19/20251119519369.jpg)

![[포토] 김고은 '단발 여신'](http://www.segye.com/content/image/2025/09/05/20250905507236.jpg)

![[포토] 박지현 '순백의 여신'](http://www.segye.com/content/image/2025/09/05/20250905507414.jpg)

![[포토] 알리익스프레스, 광군제 앞두고 팝업스토어 오픈](https://cphoto.asiae.co.kr/listimg_link.php?idx=2&no=2025110714160199219_1762492560.jpg)

![[포토] 발표하는 김정수 삼양식품 부회장](https://image.ajunews.com/content/image/2025/11/03/20251103114206916880.jpg)

![[포토] 한샘, '플래그십 부산센텀' 리뉴얼 오픈](https://image.ajunews.com/content/image/2025/10/31/20251031142544910604.jpg)

![[포토] 아이들 소연 '매력적인 눈빛'](http://www.segye.com/content/image/2025/09/12/20250912508492.jpg)

![[포토]끝내기 안타의 기쁨을 만끽하는 두산 안재석](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.0df70b9fa54d4610990f1b34c08c6a63_P1.jpg)

![[포토] '삼양1963 런칭 쇼케이스'](https://image.ajunews.com/content/image/2025/11/03/20251103114008977281.jpg)

![[포토] 언론 현업단체, "시민피해구제 확대 찬성, 권력감시 약화 반대"](https://image.ajunews.com/content/image/2025/09/05/20250905123135571578.jpg)

![[포토]두산 안재석, 연장 승부를 끝내는 2루타](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.b12bc405ed464d9db2c3d324c2491a1d_P1.jpg)

![[포토] 김고은 '상연 생각에 눈물이 흘러'](http://www.segye.com/content/image/2025/09/05/20250905507613.jpg)

![[포토] 키스오브라이프 쥴리 '단발 여신'](http://www.segye.com/content/image/2025/09/05/20250905504358.jpg)

![[포토] 아홉 '신나는 컴백 무대'](http://www.segye.com/content/image/2025/11/04/20251104514134.jpg)